不到4万元组装一台在本地运行完整DeepSeek大模型的PC

在本地运行完整的DeepSeek-R1大模型(6710亿参数),曾被认为需要昂贵的硬件和复杂的配置。然而,随着硬件技术的发展和模型优化方法的进步,现在可以在相对经济的硬件配置上实现这一目标。本文将详细介绍如何以约不到4万元的预算,配置硬件并设置软件环境,以在本地运行完整的DeepSeek-R1模型。

硬件配置

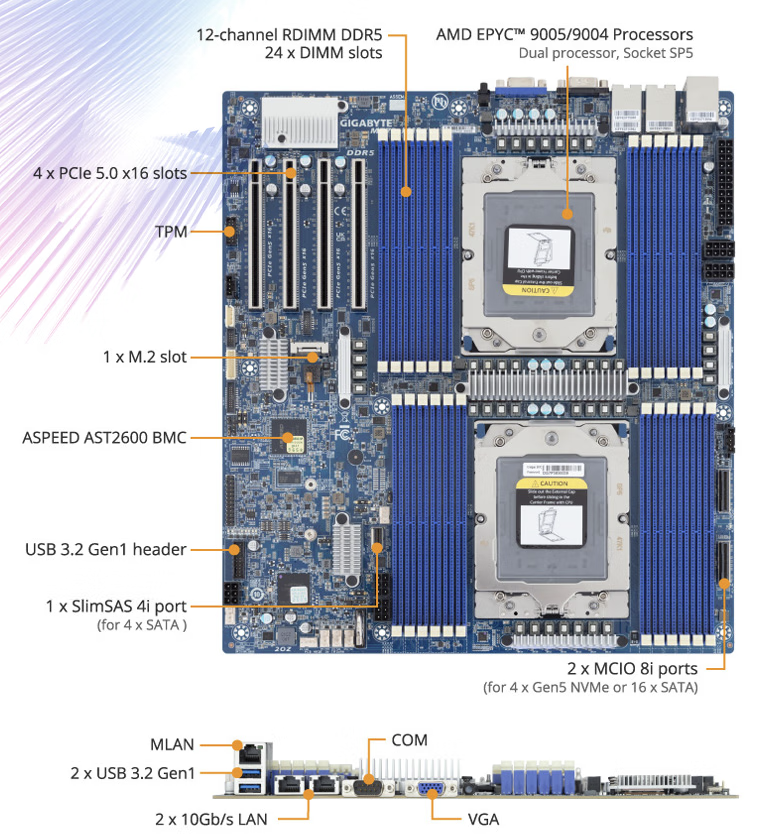

主板:技嘉MZ73-LM0或/MZ73-LM1

技嘉MZ73-LM0服务器主板支持双路EPYC处理器(9004或9005系列),24个DDR5插槽,可最大化内存容量和带宽。

处理器:AMD EPYC 9004或9005系列,大模型的瓶颈是内存带宽,因此处理器不需要最顶级的。

为了在本地运行DeepSeek-R1模型,以下是推荐的硬件配置:

| 组件 | 型号 | 预估价格(RMB) |

|---|---|---|

| 处理器(CPU) | AMD EPYC 五代 9115 | 6400 |

| 内存(RAM) | 768GB(24×32) 三星DDR4 3200 RECC服务器内存条 | 19200 京东链接 |

| 存储 | 2TB NVMe SSD | 200 |

| 电源 | 美商海盗船1200i全模组数字电源 | 2399 京东链接 |

| 主板 | 技嘉MZ73-LM0/MZ73-LM1 | 8899 |

| 机箱及散热 | 高品质机箱和散热系统 | 1000 |

| 总计 | 38000 |

如果你不想DIY,也可以考虑直接购买成熟稳定的双路霄龙EPYC工作站(双路9174F 256GB内存 52000元) 京东链接

注:价格为估计值,实际价格可能因地区和供应情况而有所差异。

配置说明:

- 处理器(CPU): AMD EPYC 9004或9005系列选便宜的即可。

- 显卡(GPU): 两块NVIDIA RTX 4090显卡,每块配备24GB显存,提供强大的计算能力和足够的显存容量。

- 硬盘:选择1TB以上的NVMe固态硬盘

- 内存(RAM): 768GB DDR4内存,确保在处理大型模型时有足够的内存空间。

- 电源: 1000W 电源即可确保系统的稳定运行。

- 主板: 选择与上述组件兼容的高性能主板,确保良好的兼容性和扩展性。

- 机箱及散热: 高品质的机箱和散热系统,确保良好的通风和散热,维持系统的稳定性。

软件环境设置

在硬件配置完成后,按照以下步骤设置软件环境:

- 安装llama.cpp

- 下载700GB的deepseek-R1-GGUF模型(Q8文件夹)

测试运行DeepSeek-R1模型

完成上述配置后,您可以使用以下命令启动DeepSeek-R1模型:

llama-cli -m ./DeepSeek-R1.Q8_0-00001-of-00015.gguf --temp 0.6 -no-cnv -c 16384 -p

此命令将加载量化后的模型,并在本地环境中运行。您可以根据需要调整脚本中的参数,以优化性能或适应特定任务。以上硬件配置的生成速度为每秒6-8个token。

性能优化建议

为了确保模型的高效运行,考虑以下优化建议:

- 显存管理: 监控GPU显存使用情况,确保模型和数据不会超出显存限制。如果出现显存不足的问题,考虑进一步降低模型的量化位数或使用分布式推理技术。

- 批处理大小: 根据任务需求调整批处理大小(batch size)。较大的批处理大小可以提高GPU利用率,但也会增加显存占用。根据实际情况进行权衡。

- 混合精度训练: 如果需要进一步提升性能,考虑使用混合精度训练(Mixed Precision Training)技术。这可以在保持模型精度的同时减少计算量和显存占用。

通过上述硬件和软件配置,您可以在本地高效地运行DeepSeek-R1模型。这为开发和测试提供了灵活性,同时避免了云计算资源的成本和限制。请根据您的具体需求和资源,适当调整配置,以获得最佳性能。

参考链接:https://x.com/carrigmat/status/1884244397174448142

第一时间获取面向IT决策者的独家深度资讯,敬请关注IT经理网微信号:ctociocom

除非注明,本站文章均为原创或编译,未经许可严禁转载。

相关文章: